ChatGPT mit eigenen Daten nutzen: Eine Einführung in RAG-Chatbots

Seit seiner Veröffentlichung Ende 2022 hat ChatGPT die Künstliche Intelligenz in den Mittelpunkt der Gesellschaft katapultiert.

Seitdem herrscht ein völlig neues Verständnis davon, wie Menschen mit KI-gesteuerten RAG-Bots (Retrieval Augmented Generation) interagieren und was mit ihnen möglich ist. Auch Unternehmen erkennen zunehmend die revolutionären Auswirkungen generativer KI auf die Geschäftswelt und überlegen, wie sie die Technologie gewinnbringend für sich nutzen können. Denn klar ist: Wer jetzt schnell handelt und KI erfolgreich in seine Geschäftsprozesse integriert, sichert sich erhebliche Wettbewerbsvorteile. Deutlich zu benennen sind ein höherer Grad der Automatisierung und verbesserte Kosteneffizienz durch den Einsatz von RAG-Chatbots. Wer hingegen den Aufsprung auf den Zug verpasst, riskiert einen Rückstand auf Wettbewerber. Es ist daher unerlässlich, dass Unternehmen verstehen, wie ChatGPT und generative KI ihre Wettbewerbsposition stärken können.

Die Nutzung von ChatGPT in Geschäftsprozessen kann auf verschiedene Weisen erfolgen, wobei eine vielversprechende Möglichkeit darin besteht, den Chatbot mit firmeneigenem Wissen zu bereichern. Dies kann realisiert werden, indem eine Wissensdatenbank aufgebaut wird, auf die das Sprachmodell für die Beantwortung von Fragen zurückgreift. Ein solches System wird auch als Retrieval Augmented Generation bezeichnet.

Was ist Retrieval Augmented Generation?Retrieval Augmented Generation (RAG) ist ein Prozess, bei dem die Eingaben eines Benutzers in ein Large Language Model (LLM) wie ChatGPT durch zusätzliche Informationen ergänzt werden. Typischerweise greift der Chatbot dafür auf eine Wissensdatenbank zurück. Das LLM kann dann diese Informationen verwenden, um die Frage des Benutzers zu beantworten. |

Es bildet eine Art alternative Such-Engine für Inhalte von Dokumenten oder Artikeln. Statt relevante Inhalte per Schlagwort-Suche oder Schlüsselwörter zu filtern, „rede“ ich mit den Dokumenten. Die Methode hat drei bedeutende Vorteile:

- Ich nutze das bereits ausgereifte sprachliche Verständnis eines Modells wie ChatGPT3.5 und muss kein LLM von Grund auf neu trainieren und tunen.

- Das Wissen des Chatbots wird beliebig erweitert. Ein aufwendig trainiertes Sprachmodell wie ChatGPT3.5 weiß bereits viel, aber durch RAG kann ich theoretisch virtuelle Experten zu verschiedenen Domänen ausbilden.

- Die Suche nach Inhalten wird interaktiv und intuitiv. Ich kann mich über gesuchte Inhalte unterhalten und mir Sachverhalte erklären lassen. Bei der Suche sind keine genauen Bezeichnungen entscheidend, sondern die inhaltliche Bedeutung.

In diesem Blogartikel möchten wir die Methodik der RAG näher vorstellen und Potenziale des Chatbot-gestützten Wissensmanagements zeigen.

RAG-Chatbots: Die Fusion von retrival-basierten und generativen Modellen

RAG-Chatbots kombinieren derzeit das Beste aus retrieval-basierten und generativen Modellen. Während retrieval-basierte Modelle eine Datenbank durchsuchen, um die relevanteste Antwort zu finden, können generative Modelle Antworten dynamisch erstellen. Die Verschmelzung dieser beiden Modelle macht RAG-Chatbots sehr vielseitig und effizient.

Vereinfacht gesagt, bestehen solche Systeme aus zwei Komponenten:

- Einem generativen Sprachmodell

- Einer Wissensdatenbank

Als Sprachmodell stellen wir uns für ein Beispiel den geläufigen OpenAI Chatbot ChatGPT vor. Als Wissensdatenbank werden zumeist Vektordatenbanken verwendet, weshalb wir auch in unserem Beispiel von einer Vektordatenbank ausgehen.

Was ist eine Vektordatenbank?Eine Vektordatenbank ist ein spezieller Typ von Datenbank, der Daten als hochdimensionale Vektoren speichert. Diese Vektoren sind mathematische Darstellungen von Merkmalen oder Attributen. Jeder Vektor hat eine bestimmte Anzahl von Dimensionen, die je nach Komplexität und Granularität der Daten von zehn bis zu Tausenden reichen kann. Die Vektoren werden in der Regel durch Anwendung einer Transformation oder Einbettungsfunktion auf die Rohdaten wie Text, Bilder, Audio, Video usw. erzeugt. |

Der Hauptvorteil einer Vektordatenbank besteht darin, dass sie eine schnelle und genaue Suche nach ähnlichen Daten ermöglicht. Das bedeutet, dass Sie statt herkömmlicher Methoden der Datenbankabfrage auf der Grundlage exakter Übereinstimmungen oder vordefinierter Kriterien eine Vektordatenbank verwenden können, um die ähnlichsten oder relevantesten Daten auf der Grundlage ihrer semantischen oder kontextuellen Bedeutung zu finden. Dadurch eignet sich eine Vektordatenbank hervorragend für die Suche von Ähnlichkeiten in unstrukturierten Daten wie Texten und Bildern.

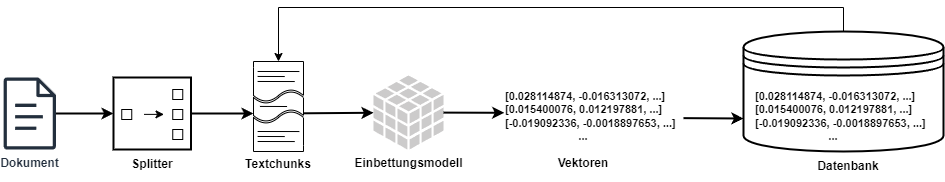

Um große Mengen von Textdokumenten in einer Vektordatenbank abzuspeichern, wird folgendes Verfahren angewandt:

- Aus einem Dokument wird der Text extrahiert.

- Der Text wird durch einen sogenannten Splitter in kleinere Stücke unterteilt.

- Die Textstücke werden einem Einbettungsmodell übergeben.

- Das Einbettungsmodell erstellt aus den Textstücken Vektoren und verknüpft sie mit ihrem jeweiligen Textinhalt.

- Die Vektoren werden in einer Vektordatenbank gespeichert und referieren auf ihr jeweiliges Textstück.

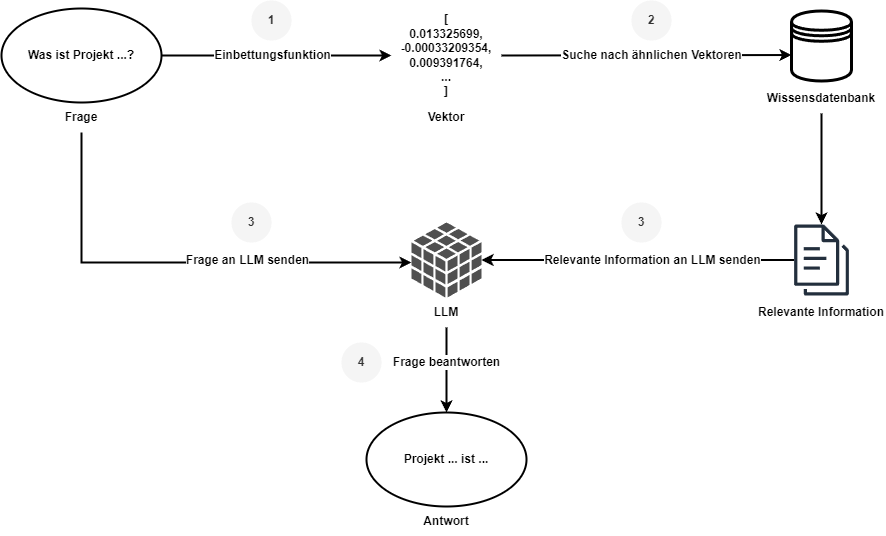

Ein RAG-System macht sich dieses Verfahren zunutze, indem es auch die Frage eines Benutzers in einen Vektor umwandelt (1). Dabei repräsentiert der Vektor nicht die reine Kombination aus alphanumerischen Zeichen oder Wörtern, sondern semantische Information. Der Chatbot erhält auf diese Weise ein gewisses sprachliches Verständnis von der Frage.

Anschließend sucht das System in der Wissens(vektor)datenbank nach Vektoren, die dem der Frage ähnlich sind (2). Findet es einen oder mehrere ähnliche Vektoren, ruft es die damit verknüpften Textstücke auf und hängt sie der Frage des Benutzers als Kontext an, bevor der Chatbot die Frage erhält. Die Textstücke liefern Hintergrundwissen, die der Chatbot zur Beantwortung der Frage benötigt. Fortan sieht der Chatbot also nicht mehr nur die Frage des Benutzers, sondern die Frage und den Kontext (3). Der Chatbot versucht zuletzt die Frage des Benutzers mit dem ihm vorliegenden Kontext zu beantworten (4).

In der Theorie kann ein RAG-Chatbot also sämtliche Fragen zu einem Thema beantworten, vorausgesetzt die Antwort befindet sich in einem Bestand von Dokumenten.

Die Stärken von RAG: Überwindung der Schwächen rein generativer Chatbots

- Der Wissensschatz kann beliebig verändert werden. Es können Informationen hinzugefügt, entfernt und aktualisiert werden und der Chatbot greift immer auf den neuesten Stand der Informationen zu.

- Domänenwissen wird zuverlässiger wiedergegeben. Während ChatGPT ohne RAG bei der Wiedergabe sehr spezifischer Information zu Halluzinationen tendiert, sind die Ergebnisse mit RAG relevanter, sofern sie in der Wissensdatenbank enthalten sind.

Der produktive Einsatz von Chatbots in der Geschäftswelt wird dadurch noch flexibler und effizienter, was neue Einsatzfelder eröffnet.

Potenziale des RAG-gestützten Wissensmanagements

Die Methodik des RAG-gestützten Wissensmanagements könnte nahezu jede Branche revolutionieren, indem sie die Fähigkeit besitzt, schnell und präzise profunde Informationen aus umfangreichen Textmengen abzurufen. RAG-Chatbots verknüpfen die Fähigkeiten von Suchmaschinen mit der Textgenerierung und ermöglichen es, auf Anfragen mit komplexen Antworten zu reagieren, die auf individuellen Wissensdatenbanken basieren.

Durch den Einsatz von RAG werden Prozesse der Wissensgenerierung und -wiedergabe wesentlich verbessert. Den Anwendungsfeldern und Branchen sind keine Grenzen gesetzt:

| Gesundheitswesen |

| Automatisierte Diagnosen und Befunde: RAG kann Ärzte und medizinisches Personal bei der Interpretation von Patientendaten unterstützen, indem es relevante Informationen aus medizinischen Aufzeichnungen, Forschungsdaten und klinischen Leitlinien extrahiert, um genaue Diagnosen und Befunde zu erstellen. |

| Juristische Dienstleistungen |

| Juristische Fallbearbeitung: Ein RAG-basierter Chatbot kann Anwälten und juristischem Personal bei der Recherche von Gesetzen, Präzedenzfällen und anderen rechtlichen Dokumenten helfen, um fundierte juristische Entscheidungen zu treffen. |

| Industrie und Fertigung |

| Wartung und Reparatur: Durch die Integration in Maschinen und Geräte können Bedienungsanleitungen und Wartungshinweise leicht abgerufen werden, um technisches Personal bei Wartungsaufgaben zu unterstützen. Chatbots können Schritt-für-Schritt-Anleitungen bieten. |

| Bildung |

| Individualisierte Lernmaterialien: Lehrer können RAG nutzen, um personalisierte Lernmaterialien für Schüler zu erstellen, die auf ihren individuellen Bedürfnissen und Fortschritten basieren. |

| Finanzdienstleistung |

| Kundenberatung und -unterstützung: RAG kann in Chatbots integriert werden, um Kunden bei Bankgeschäften, Finanzplanung und Anlageentscheidungen zu unterstützen. |

| E-Commerce |

| Produktmanagement: Produktdatenbanken können befragt werden, um Produkte zu vergleichen, Content zu generieren und Analysen durchzuführen. Die Produktentwicklung kann durch teilautomatisierte Entscheidungen beschleunigt werden. Gleichzeitig kann ein RAG-Chatbot eine Produktdatenbank nutzen, um Kundenanfragen zu beantworten. |

Wie ChatGPT und RAG-Chatbots die Zukunft prägen

RAG im Wissensmanagement zeigt ein beeindruckendes Potenzial. Eine Implementierung der Technologie dürfte in Unternehmen eine bemerkbare Produktivitätssteigerung bewirken. Dabei sind die Prozesse, die RAG verbessert, vielseitig und branchenübergreifend vorzufinden.

Beeindruckend ist auch das Tempo, mit dem sich Chatbots derzeit weiterentwickeln. Innerhalb von weniger als einem Jahr nach der Veröffentlichung von ChatGPT bestehen bereits ausgereifte Anwendungsbeispiele, die die Interaktion mit großen Wissensschätzen vorantreibt. Hinzu kommen Weiterentwicklungen wie selbstständige KI-Agenten und multimodale Chatbots, die nochmals Chancen eröffnen und die Fähigkeiten von Chatbots erweitern. Es bleibt spannend zu beobachten, welche Wege die generative KI noch einschlagen wird.

Mehr zu Data Driven Services erfahren